TL;DR

Naast mensen is er een nieuwe gebruiker van je website: de AI-agent die taken uitvoert namens klanten. Google, OpenAI, Anthropic en Perplexity geven inmiddels allemaal richtlijnen om je site agent-ready te maken. Dit verkeer zie je niet in je analytics, dus je merkt pas dat het misgaat als concurrenten aanbevolen worden. Met vijf gratis tools kun je vandaag checken hoe ver je bent.

Een afspraak inplannen, een offerte aanvragen, een product vergelijken en bestellen. Het gevolg voor marketing is concreet: alleen zichtbaar zijn of geciteerd worden in AI-antwoorden is niet meer genoeg (ook nooit geweest); je site moet ook door agents gebruikt kunnen worden. Als een agent op jouw site vastloopt en bij de concurrent soepel afrekent, kiest hij de concurrent volgende keer. De klant krijgt alleen het resultaat te zien. Vroeg meedoen geeft een voorsprong die later moeilijk in te halen is. Dat brengt je bij de vraag waar deze blog over gaat: kan een agent jouw site al gebruiken en hoe kun je dat verbeteren?

Agents worden nu al massaal gebruikt

Het is geen toekomstmuziek meer. Volgens een rapport van HUMAN Security groeide het verkeer van AI-agents in 2025 met 7.851% jaar-op-jaar en vindt inmiddels 2,3% van alle AI-agentactiviteit plaats op checkout-pagina's. Agents lezen dus niet alleen, ze rekenen ook af. Google publiceerde recent op web.dev een officiële guide ("Build agent-friendly websites") waarin het ontwikkelaars expliciet oproept om sites te bouwen met de AI-agent als eersteklasbezoeker in gedachten. OpenAI, Anthropic en Perplexity hebben ondertussen elk hun eigen documentatie voor sitebeheerders gepubliceerd. Agent Optimization is daarmee geen experiment van een paar early adopters meer, maar een ontwerpopdracht die op hetzelfde niveau staat als responsive design tien jaar geleden.

Wat is Agent Optimization?

Agent Optimization is de discipline om een website zo te bouwen dat een AI-agent er betrouwbaar mee kan werken. Niet door een aparte versie van je site te bouwen, maar door de bestaande site zo te structureren dat hij voor een agent net zo leesbaar en bruikbaar is als voor een mens.

De vergelijking die Google zelf maakt is goed: wat helpt voor toegankelijkheid (screenreaders, mensen met beperkingen), helpt ook voor agents. Beide moeten een pagina kunnen begrijpen zonder zich te verlaten op visuele context. Semantische HTML in plaats van losse divs, gekoppelde labels aan formuliervelden, stabiele layouts in plaats van schuivende elementen, een duidelijke heading-structuur. Dat zijn dingen die marketeers al kennen uit accessibility-checks, alleen krijgen ze er nu een tweede zakelijke reden bij.

Wat de grote AI-spelers er zelf over zeggen

Het bijzondere is dat de adviezen van Google, OpenAI, Anthropic en Perplexity opvallend met elkaar overlappen. Niet omdat ze afspraken hebben gemaakt, maar omdat ze allemaal tegen hetzelfde probleem aanlopen: hoe lees je een site die voor mensenogen is gebouwd.

Google publiceerde een officiële guide op web.dev en plaatst agent-friendliness daarmee naast performance en accessibility als ontwerprichtlijn. OpenAI legt voor ChatGPT Atlas, hun browseragent, uit dat agents pagina's lezen via ARIA-tags: dezelfde labels en rollen die screenreaders gebruiken. Anthropic doet voor Claude for Chrome iets vergelijkbaars en leest pagina's primair via de onderliggende paginastructuur. Perplexity adviseert vooral een heldere contentstructuur en het niet verstoppen van content achter JavaScript.

De rode draad is helder: agents lezen je site niet zoals een mens dat doet via beeld en kleur, maar via de onderliggende structuur, dezelfde laag waar screenreaders voor blinde gebruikers op draaien. Wie zijn site nu al toegankelijk maakt voor screenreaders, doet automatisch ook een groot deel van het werk voor AI-agents.

Waarom je het niet in je analytics ziet

Een belangrijk punt om in je achterhoofd te houden: het verkeer van AI-agents is grotendeels onzichtbaar in de huidige dashboards waar marketing op stuurt. Een agent klikt en scrolt soms wel, maar dan mechanisch en in seconden, niet als een mens die rondkijkt en twijfelt. Geen scroll depth, geen time-on-page, geen tutorial completions, geen conversies in de klassieke zin. Toch is hij wel degelijk geweest; heeft hij je content gelezen en heeft hij op basis daarvan een aanbeveling gedaan of niet.

5 gratis Agent Optimization tools om jouw website te verbeteren

Nu wil je natuurlijk gelijk weten hoe agent-ready jouw site al is en wat je verder kunt verbeteren. Goed nieuws: er zijn een paar hele goede gratis tools waarmee je direct aan de slag kunt met Agent Optimization.

Een waarschuwing vooraf om verwarring te voorkomen: er zijn twee scanners met bijna identieke namen,Externe linkisagentready.com (zonder "it") enExterne linkisitagentready.com (mét "it"). Het zijn twee verschillende tools van twee verschillende makers en ze meten ook andere dingen. Goed om ze beide te kennen.

Glippy is een Chrome-extensie van de Nederlandse SEO-professional Jan Willem Bobbink die analyseert of je pagina klaar is voor LLM-crawlers, AI-agents en AI-interfaces zoals ChatGPT, Perplexity en Google AI Overviews. De tool draait meer dan 240 checks lokaal in je browser, verdeeld over 16 categorieën, waaronder semantische structuur, machine readability, structured data en WebMCP-compatibiliteit. Je krijgt een score van 0-100 met een letter grade en concrete verbeterpunten per categorie. Omdat de scan lokaal draait, gaat er geen data naar een server. Er is een gratis en een betaalde variant; een desktop-app staat op de planning.

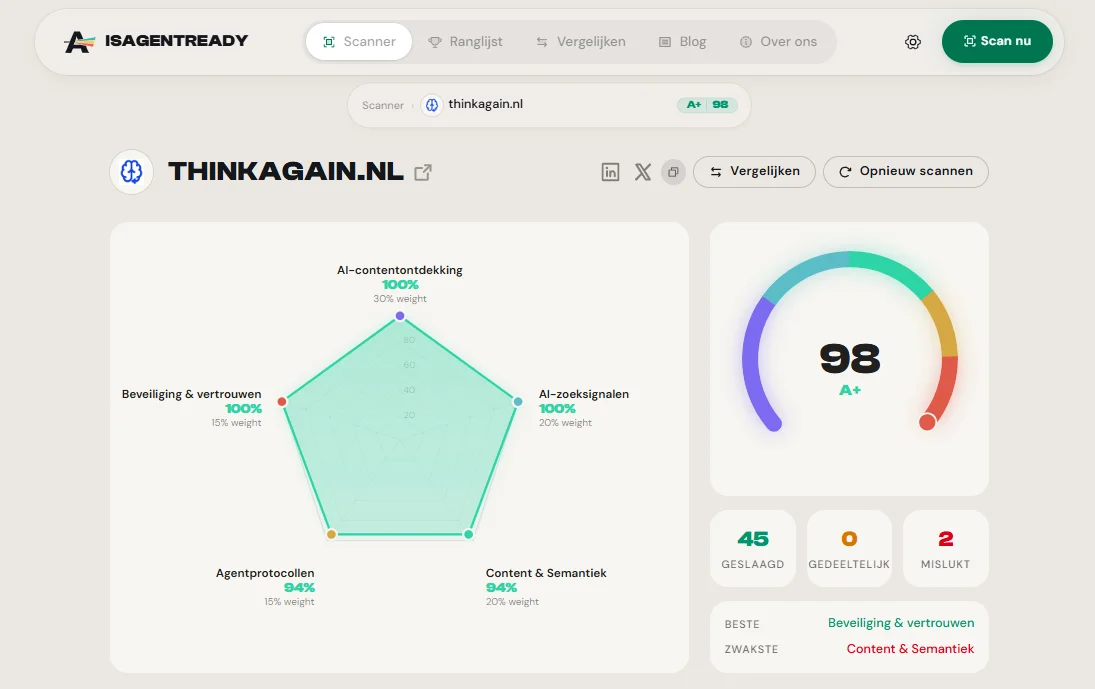

isagentready.com is een Nederlandstalige agentscanner van Bart Waardenburg die je site beoordeelt op vijf categorieën: AI-contentontdekking (robots.txt voor de grote AI-bots, sitemaps, llms.txt), AI-zoeksignalen (JSON-LD, schema.org, entity linking), content & semantiek (accessibility tree, kopjeshiërarchie, SSR-detectie), agentprotocollen (WebMCP, A2A Agent Cards, MCP discovery, OpenAPI) en beveiliging & vertrouwen (HTTPS, HSTS, CSP). Je krijgt een score per categorie met een letter grade en concrete aanbevelingen, en je kunt jezelf vergelijken met andere sites via de ranglijst. Voor marketing is dit waarschijnlijk de meest bruikbare van het stel: de categorieën sluiten goed aan op de manier waarop je over je website nadenkt.

isitagentready.com is van Cloudflare en kijkt naar dezelfde vraag vanuit een andere hoek: meer infrastructuur, minder content. De tool scoort je site op vier dimensies (discoverability, content accessibility, bot access control, capabilities) en checkt onder andere robots.txt, markdown content negotiation, MCP-endpoints en OAuth. Voor elke gefaalde check krijg je een prompt die je rechtstreeks in een coding-agent (Claude Code, Cursor) kunt plakken om de fix te laten uitvoeren. Goede aanvulling op isagentready.com als je dieper in de techniek wilt duiken.

Siteline Agent Readiness Check is een gratis scan die specifiek kijkt of AI-agents en crawlers je content kunnen vinden, openen en interpreteren. De tool checkt onder andere bottoegang via robots.txt, indexeringssignalen zoals canonicals, titles en meta robots-tags, en technische blokkades zoals client-only rendering en trage responses. Een goede aanvulling als je vooral wilt weten waar agents stuk lopen voordat ze überhaupt bij je content komen.

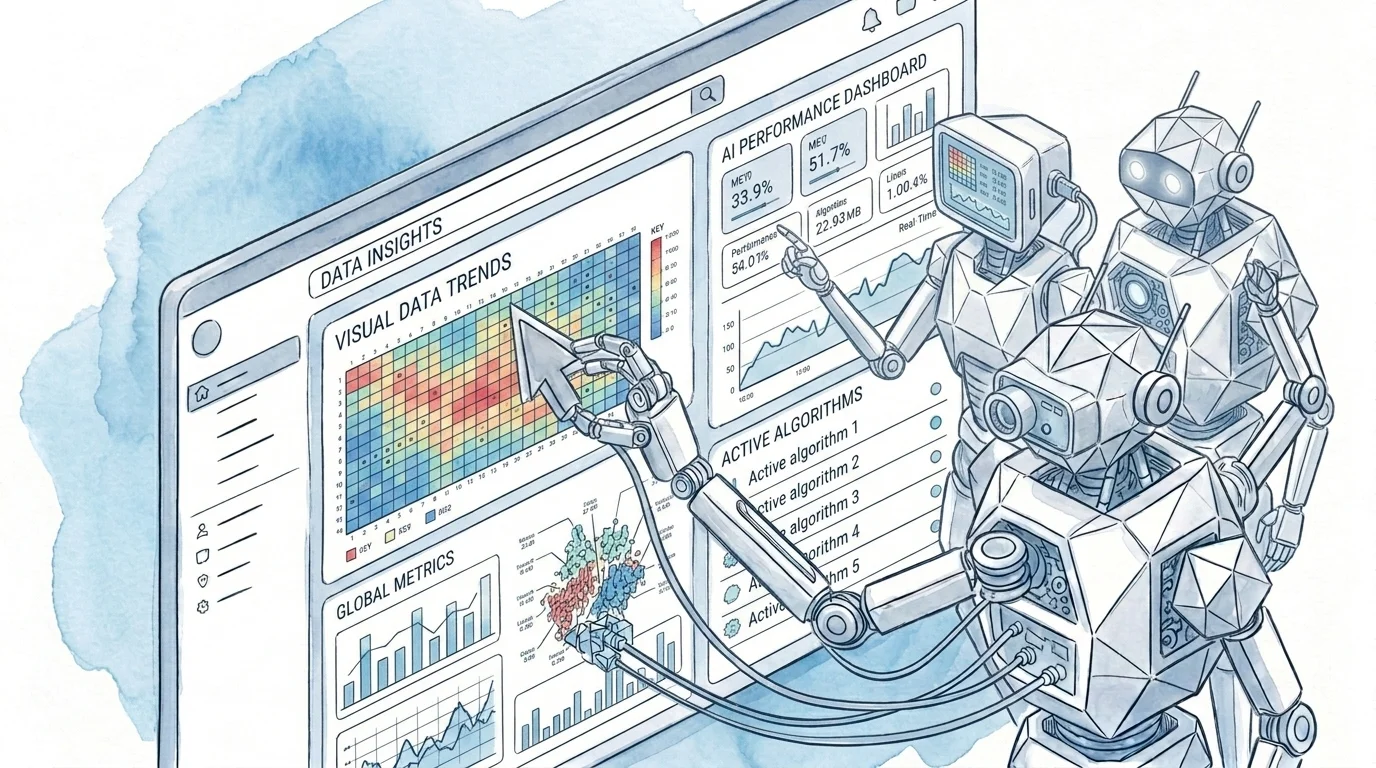

Naast deze vier tools die je laten zien hoe agent-ready jouw site is, is de LLM Content Visibility Scanner van Algorythmic, gemaakt door Lily Ray, een handige aanvulling. Deze tool meet iets anders: hij laat zien hoe een LLM jouw pagina ziet wanneer hij hem ophaalt, oftewel wat er overblijft van je content nadat een AI hem heeft geparseerd.

Analyseer je site met deze tools (ze zijn gratis en heel gemakkelijk te gebruiken) en kijk welke verbeterpunten eruit komen en consistent terugkomen. Dat geeft je een handig eerste prioriteitenlijstje zonder dat je meteen je hele technische roadmap hoeft om te gooien. En iedere tool licht net weer wat andere zaken uit, zodat je een gezamenlijk compleet beeld krijgt van jouw ‘AI Agent Score’.

Tot slot

Agent Optimization is de logische volgende stap in een lijn die loopt van zoekmachines optimaliseren (SEO) naar in AI-antwoorden genoemd worden (GEO/AEO) naar door agents uitgevoerd kunnen worden (Agent Optimization). De drie versterken elkaar: schone semantische HTML, duidelijke contentstructuur en stabiele technische fundamenten helpen alle drie tegelijk. Het verschil is alleen dat de toetssteen verandert. Bij SEO word je gevonden door een crawler. GEO gaat om aanbevolen worden door AI. Maar wil je echt aan de slag met AI Search, dan moet Agent Optimization een belangrijk onderdeel zijn van je strategie.

Wil je echt aan de slag met AI Search? Dan moet Agent Optimization een belangrijk onderdeel zijn van je strategie.

Bij Agent Optimization is het: kan een agent op mijn site daadwerkelijk de taak afronden die hij namens een klant probeert te doen? Waarschijnlijk is dat over een korte tijd nog gemakkelijker om technisch te regelen en geeft het je geen competitief voordeel meer, nu nog zeker wel.